AMERIČKA vojska navodno je koristila Claude, AI model kompanije Anthropic, za prikupljanje informacija u napadu na Iran, uprkos odluci predsednika Donalda Trampa da samo nekoliko sati ranije prekine sve veze s tom kompanijom i njenim alatima.

Korišćenje Claudea tokom masovnog zajedničkog američko-izraelskog bombardovanja Irana, koje je započelo juče, naglašava složenost povlačenja moćnih AI alata iz vojnih misija nakon što je tehnologija već duboko integrisana u operacije, piše The Guardian.

Prema pisanju Wall Street Journala i Axiosa, komanda američke vojske koristila je ove alate u obaveštajne svrhe, kao i za pomoć pri odabiru ciljeva i sprovođenju simulacija na bojnom polju. Samo nekoliko sati pre početka napada na Iran, Tramp je prekjuče naložio svim saveznim agencijama da odmah prekinu korišćenje Claudea.

A, kako je sve počelo…

Sve to postoji u knjigama, filmovima i stripovima. I krv i blato, i hibridni ratovi i hakeri, i propaganda i sajber-pešadija po hangarima – od Kamčatke, preko Delhija i makedonskog Velesa, do Arlingtona. Opustošena polja Ukrajine prekrivena optičkim vlaknima, klinci sa džojsticima u rukama umesto pušaka, i veštačke inteligencije koje povlače virtuelni oroz i navode rakete.

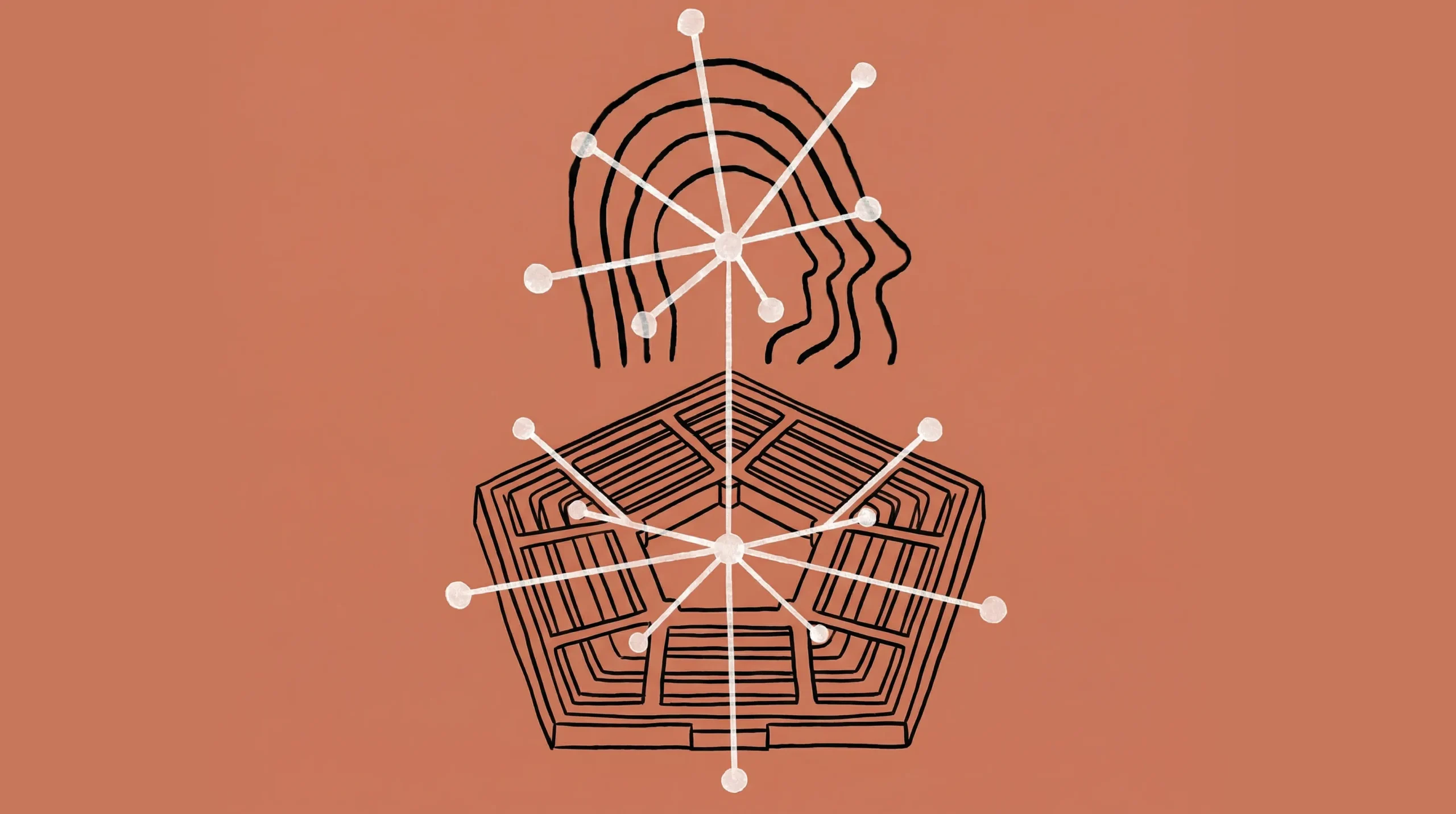

Munjeviti prelazak iz konvencionalnog ratovanja u hibridno, a zatim i u ovo novo, potpuno digitalizovano, izbrisao je te tanke linije između naučne fantastike i realnosti. Zato više ne zvuči neverovatno to da se u Pentagonu vodi mali rat oko tzv. javno-privatnog partnerstva koje bi do juče pripadalo distopijskom romanu: ko i pod kojim uslovima sme da koristi najmoćnije AI modele, i gde su granice kad ti modeli uđu u poverljive sisteme.

Američki sekretar odbrane Pit Hegset pozvao je ranije ove nedelje Darija Amodeija, direktora kompanije Antropik, na sastanak za koji, kako je rekao jedan neimenovani visoki vojni američki zvaničnik, nije planirano da bude prijateljski, već da bude „uzmi ili ostavi“. Tačka sporenja i ulog nisu nimalo apstraktni, jer Pentagon traži da AI modeli ne pametuju mnogo i da budu dostupni za „sve zakonite upotrebe“, dok Antropik hoće da zadrži dve crvene linije – masovni nadzor građana Amerike i razvoj oružja koje dejstvuje bez čoveka u lancu odlučivanja.

„Problem sa Dariom je taj što je za njega ovo ideološki sukob. Znamo sa kim imamo posla“, rekao je izvor iz vojske za američke medije.

Antropikov model Klod (Claude) srce je AI sistema koji američka vojska koristi u svom takozvanom „kill chainu“, odnosno procesu koji vodi od tačke „pronađi metu“ do samog kraja i poslednjih karika – „dejstvuj“ i „proceni rezultat“.

Poštovani, da biste nastavili sa čitanjem naših premium sadržaja, neophodno je da odaberete jedan od planova pretplate.

Već imate nalog? Ulogujte se